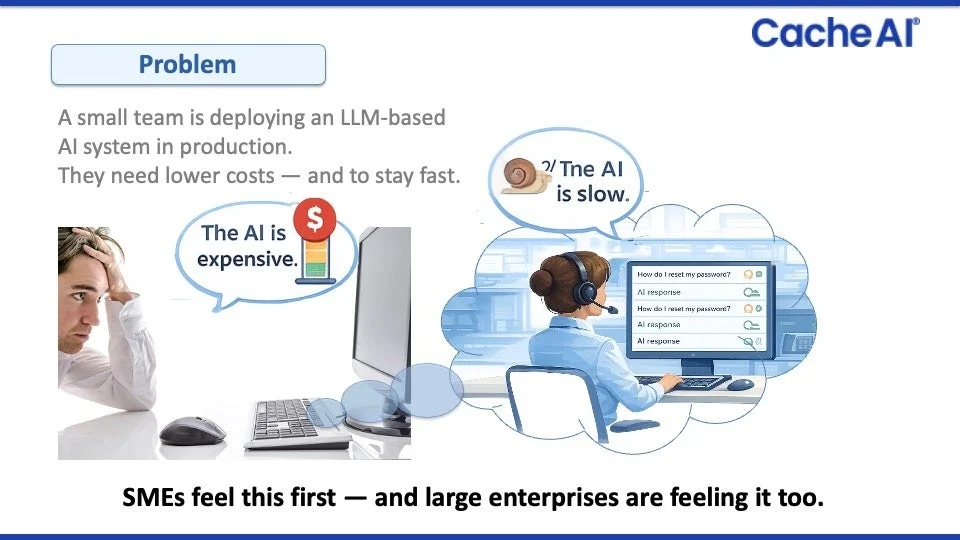

AI実装を阻む「コスト」と「遅延」の壁を打破する提言

現在、大規模言語モデル(LLM)の社会実装においては、特にリソースが限られる中小企業にとって、「従量課金によるコストの不確実性」と「応答速度(レイテンシ)によるユーザーエクスペリエンスの低下」が導入の大きな障壁となっています。

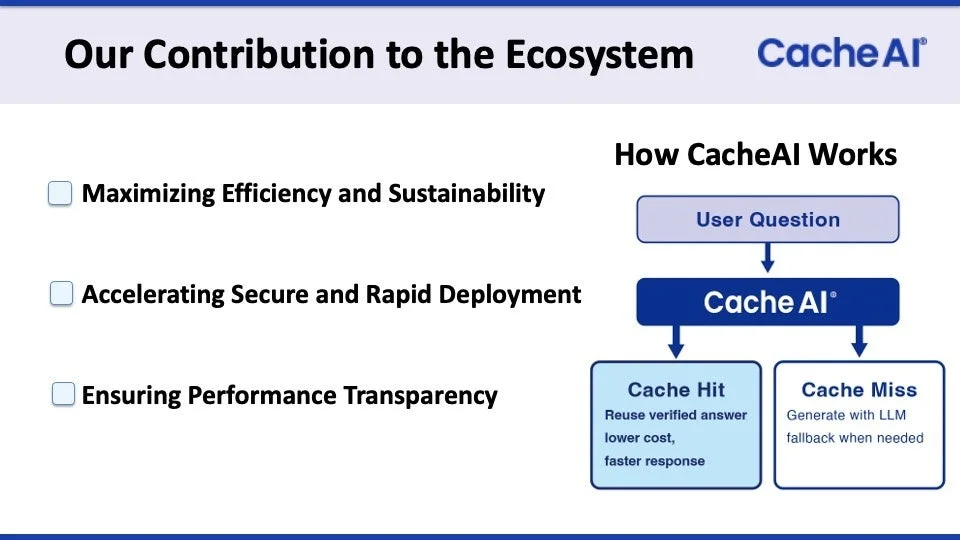

Geek Guildはブレイクアウトセッションで、「AIの性能(Accuracy)だけでなく、ビジネス実装における持続可能性(Sustainability)に目を向けるべきだ」と提言しました。具体的には、以下の3つの指標(スコアカード)を軸にした実装の重要性が共有されています。

-

Cost Predictability(コストの予測可能性): 従量課金が企業の財務を圧迫しない設計が求められます。

-

High-Speed Response(高速応答): 業務フローを止めないミリ秒単位のレスポンスが重要です。

-

Implementation Quality(実装品質): 現場で保守・運用が回り続けるための設計思想が必要とされます。

展示内容:「Cache AI」コンセプト

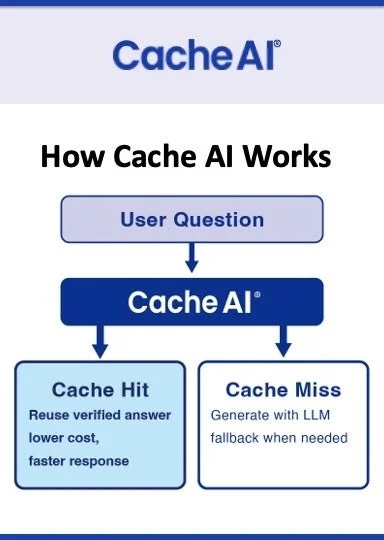

展示ブースでは、既存のAIシステムとLLMの間に「ミドルウェア層」を置く、Geek Guild独自のコンセプト「Cache AI」が紹介されました。このシステムは、繰り返し発生する問い合わせ(Repetitive Q&A)などのワークフローにおいて、以下のハイブリッドな運用を可能にします。

-

Cache Hit: 過去に検証済みの回答を再利用することで、APIコストをゼロに抑え、ミリ秒単位の高速応答を実現します。

-

Cache Miss: 必要な場合にのみLLMへフォールバックし、最新かつ高度な回答を生成します。

このアプローチにより、AI導入のROI(投資対効果)を劇的に改善し、実務に耐えうる「持続可能なAIインフラ」の構築を支援します。

今後の展望

Geek Guildは、今後もPartners Communityの活動を通じて、日本と米国(CacheAI Technologies, Inc.)の両拠点から現場起点の実装知見を世界へ発信していく方針です。HAIPの精神に則り、安全かつ透明性が高く、そして何よりも「現場で使い続けられる」AI社会の実現に貢献していくことが期待されます。

会社概要

-

株式会社Geek Guild(Geek Guild Co., Ltd.)

-

代表取締役CEO:尾藤美紀

-

所在地:京都府京都市

-

米国法人:CacheAI Technologies, Inc.

-

URL:

-